Gemini’nin utanç verici imgeleri için Google’dan acil açıklama geldi

Google, Gemini yapay zeka aracının ürettiği “utanç verici ve yanlış” olarak tanımlanan manzaralar için bir açıklama yaptı. Cuma günü bir blog yazısında Google, modelinin ayar sıkıntıları nedeniyle “yanlış tarihsel” imgeler ürettiğini belirtiyor.

Gemini’nin ırkçı manzaraları için Google açıklama yayınladı

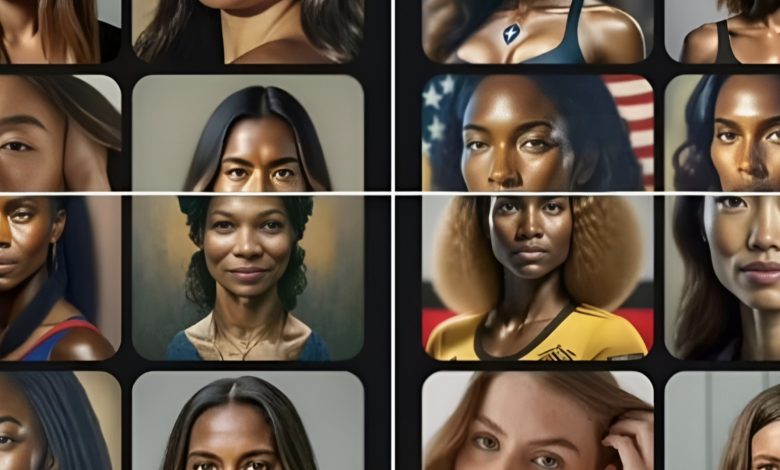

Bir çok kullanıcı, bu hafta başında Gemini’yi ırkçılıkla birlikte, çeşitli Nazi’ler ve ABD Kurucu Babaları’nı üretirken yakaladılar. Google’un kıdemli lider yardımcısı Prabhakar Raghavan blog yazısında, “Gemini’nin çeşitli insanları göstermesini sağlamak için ayarlanmasının, mutlaka çeşit göstermemesi gereken durumları hesaba katmadığını” açıkladı.

Ayrıca, “zamanla, modelin niyetimizden çok daha temkinli hale geldiğini ve kimi çok temiz istekleri hassas olarak yanlış yorumladığını” belirtiyor. Bu, Gemini AI’ın kimi durumlarda “aşırı telafi etmesine” neden oldu, motamot ırkçı Nazi’lerin imgelerinde gördüğümüz üzere.

Ayrıca, Gemini’nin “aşırı muhafazakar” hale gelmesine neden oldu. Bu, “siyahi bir kişi” yahut “beyaz bir kişi” imgelerinin makul isteklerini üretmeyi reddettiğinde sonuçlandı. Raghavan blog yazısında, Google’ın “özelliğin âlâ çalışmadığına üzgün olduğunu” belirtiyor.

Şirket, Gemini’nin “herkes için düzgün çalışmasını” istediğini ve bu, “futbolcular” yahut “bir köpeği gezdiren birini” görüntülerken farklı tipte insanların (farklı etnik kökenler de dahil olmak üzere) betimlemelerini elde etmek manasına geldiğini belirtiyor.

Raghavan şöyle diyor: Lakin, “bir sınıftaki bir siyah öğretmen” yahut “bir köpek ile bir beyaz veteriner” üzere makul tipte beşerler yahut makul kültürel yahut tarihi bağlamlardaki beşerler için Gemini’ye manzara istediğinizde, katiyetle istediğiniz şeyi gerçek bir formda yansıtan bir karşılık almalısınız.

Google Gemini’nin hizmeti yanlış imgeleri yüzünden başlamadan bitti

Şirket, Gemini AI aracıyla insanların manzaralarını oluşturmasına 22 Şubat’ta son vermişti. Hem de bu karar, birkaç hafta öncesine kadar manzara oluşturma özelliğini başlattıktan çabucak sonra geldi.

Raghavan, şirketin imaj oluşturma yeteneklerini test etmeye devam edeceğini ve tekrar etkinleştirmeden evvel “önemli ölçüde düzgünleştirmeye çalışacağını” belirtiyor.

Raghavan, “Başlangıçtan beri söylediğimiz üzere, tüm LLM’lerle (büyük lisan modelleri) halüsinasyonlar bilinen bir zorluk, yapay zeka bazen yanlış şeyler yapar. Bu, daima olarak üzerinde çalıştığımız bir şey.” açıklamasını yaptı.

Siz bu mevzu hakkında ne düşünüyorsunuz? Görüşlerinizi aşağıdaki yorumlar kısmına yazabilirsiniz.